ABU DHABI, Vereinigte Arabische Emirate--(BUSINESS WIRE)--Das Technology Innovation Institute (TII), ein führendes, internationales wissenschaftliches Forschungszentrum und die Säule für angewandte Forschung des Abu Dhabi Advanced Technology Research Council (ATRC), hat ein neues großes Sprachmodell in seiner Falcon-Reihe veröffentlicht, das Falcon Mamba 7B. Dieses neue Modell ist das weltweit leistungsstärkste quelloffene State Space Language Model (SSLM), wie von Hugging Face unabhängig bestätigt wurde.

Das erste Falcon-SSLM unterscheidet sich von früheren Falcon-Modellen, die alle eine auf Transformern basierende Architektur nutzen. Das neue Falcon Mamba 7B-Modell ist ein weiteres Beispiel für die wegweisende Forschung des Instituts und die innovativen Tools und Produkte, die es der Gemeinschaft in einem Open-Source-Format zur Verfügung stellt.

S.E. Faisal Al Bannai, Generalsekretär des ATRC und Berater des Präsidenten der Vereinigten Arabischen Emirate für strategische Forschung und fortgeschrittene Technologie, sagte: „Falcon Mamba 7B ist das vierte KI-Modell des TII in Folge, das sich einen Spitzenplatz sichert, und es stärkt Abu Dhabi als globales Zentrum für KI-Forschung und -Entwicklung. Diese Leistung unterstreicht das unerschütterliche Engagement der VAE für Innovation.“

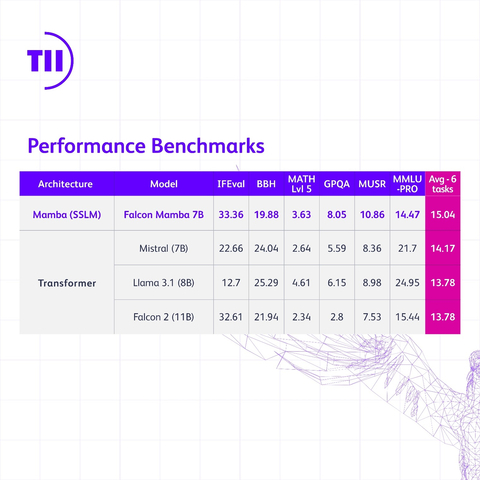

Bei den auf Transformern basierenden Architekturmodellen übertrifft das Falcon Mamba 7B das Llama 3.1 8B, das Llama 3 8B und das 7B von Mistral bei den neu eingeführten Benchmarks von HuggingFace. Im Vergleich zu den anderen SSLMs schlägt das Falcon Mamba 7B alle anderen Open-Source-Modelle bei den alten Benchmarks und wird das erste Modell in der neuen, strengeren Benchmark-Rangliste von HuggingFace sein.

Dr. Najwa Aaraj, Chief Executive von TII, sagte: „Das Technology Innovation Institute erweitert mit seinen KI-Modellen der Falcon-Reihe kontinuierlich die Grenzen der Technologie. Das Falcon Mamba 7B steht für bahnbrechende Pionierarbeit und ebnet den Weg für zukünftige KI-Innovationen, die die menschlichen Fähigkeiten erweitern und das Leben verbessern werden.“

State-Space-Modelle zeichnen sich durch eine hohe Leistungsfähigkeit beim Verständnis komplexer Situationen aus, die sich im Laufe der Zeit entwickeln, beispielsweise ein ganzes Buch. Der Grund dafür ist, dass SSLMs keinen zusätzlichen Speicher benötigen, um so große Informationsmengen zu verarbeiten.

Auf Transformern basierende Modelle hingegen sind sehr effizient darin, sich Informationen zu merken und diese Informationen, die sie zuvor in einer Sequenz verarbeitet haben, zu nutzen. Dadurch eignen sie sich sehr gut für Aufgaben wie die Generierung von Inhalten. Da sie aber jedes Wort mit jedem anderen Wort vergleichen, ist dafür eine erhebliche Rechenleistung erforderlich.

SSLMs können in verschiedenen Bereichen wie bei Schätzungen, Prognosen und Steuerungsaufgaben eingesetzt werden. Ähnlich wie die Transformer-Architekturmodelle eignen sie sich auch sehr gut für Aufgaben der natürlichen Sprachverarbeitung und können für maschinelle Übersetzung, Textzusammenfassung, Computer Vision und Audioverarbeitung eingesetzt werden.

Dr. Hakim Hacid, amtierender Chief Researcher der AI Cross-Center Unit des TII, sagte: „Ich bin stolz auf das kollaborative Ökosystem des TII, das die Entwicklung und die Markteinführung des Falcon Mamba 7B ermöglicht hat. Diese Veröffentlichung bringt uns einen großen Schritt nach vorne, inspiriert zu neuen Perspektiven und treibt die Suche nach intelligenten Systemen weiter voran. Wir am TII erweitern die Grenzen sowohl von SSLM- als auch von Transformer-Modellen, um weitere Innovationen im Bereich der generativen KI zu fördern.“

Falcon LLMs wurden über 45 Millionen Mal heruntergeladen, was ein Beweis für den enormen Erfolg der Modelle ist. Falcon Mamba 7B wird unter der TII Falcon License 2.0 veröffentlicht, der permissiven, auf Apache 2.0 basierenden Softwarelizenz, die eine Richtlinie zur verantwortungsvollen Nutzung von KI enthält. Weitere Informationen über das neue Modell finden Sie unter FalconLLM.TII.ae.

*Quelle: AETOSWire

Die Ausgangssprache, in der der Originaltext veröffentlicht wird, ist die offizielle und autorisierte Version. Übersetzungen werden zur besseren Verständigung mitgeliefert. Nur die Sprachversion, die im Original veröffentlicht wurde, ist rechtsgültig. Gleichen Sie deshalb Übersetzungen mit der originalen Sprachversion der Veröffentlichung ab.